註:本內容翻譯與改寫自 BVP 官方網站 Bessemer’s AI Agent Autonomy Scale

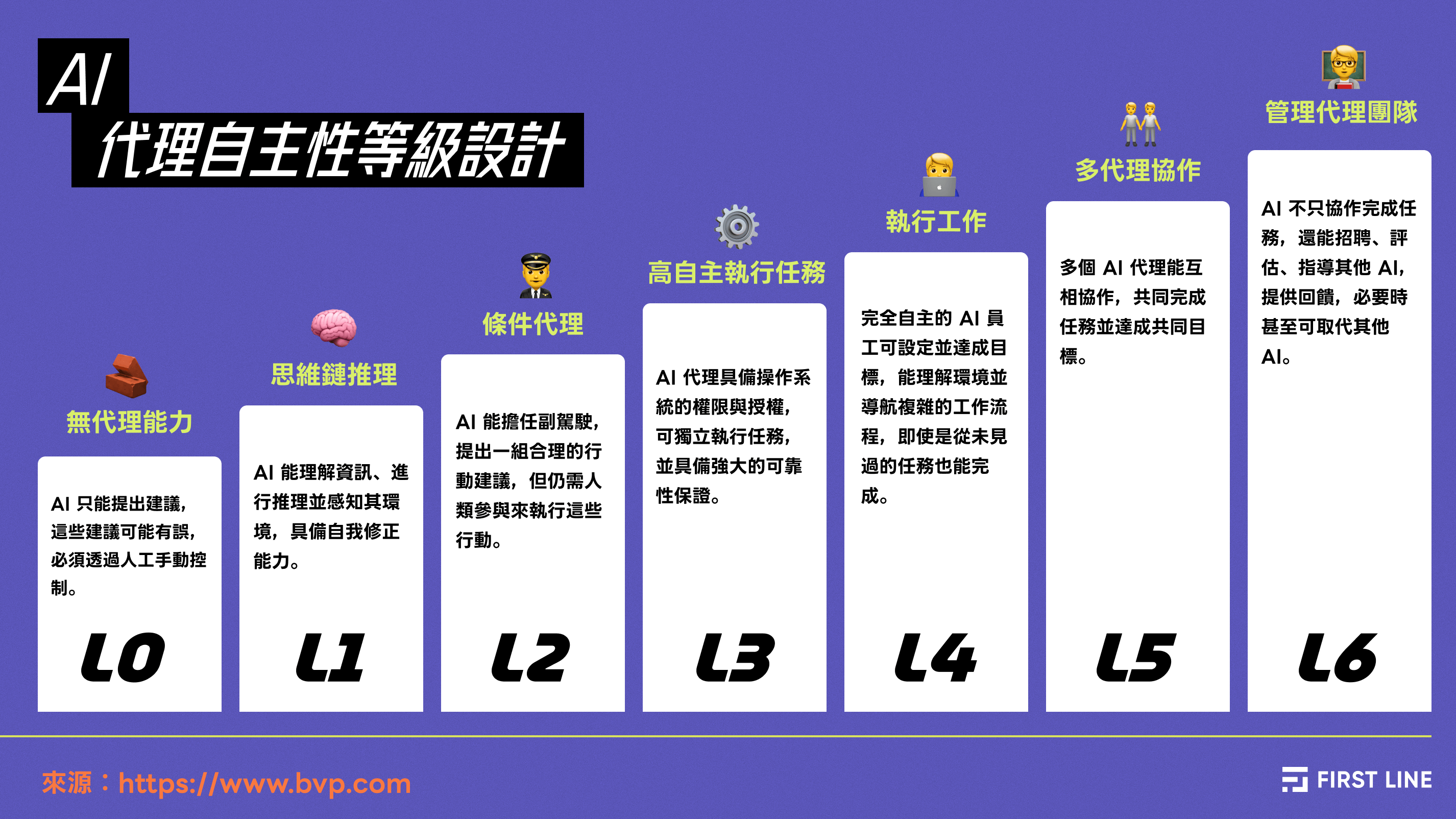

在人工智慧(AI)領域中,「AI 代理」(AI Agent)已成為熱門話題,但其確切涵義經常令人困惑。知名創投公司 Bessemer Venture Partners(BVP)注意到業界對「AI代理」的定義缺乏共識,於是在 2025 年提出一套參考自自駕車產業分級方法的架構,將 AI Agent 的自主性劃分為七個等級(L0–L6)。

這個架構不僅明確了什麼樣的系統可被視為 AI 代理,也提供了一種衡量 AI 應用成熟度的方式。對企業而言,該框架具有重要參考價值,它有助於評估當前AI方案所處的自主性層級,並作為規劃產品設計和 AI 導入路線的指南,確保在提升自主性的同時兼顧可靠性與安全性。

BVP 對 AI Agent 給出的定義是:「能運用大型基礎模型執行鏈式思維推理,並準確地對序列化工作流程採取行動的軟體應用」。換言之,一個 AI 代理應該具備:

- 對環境的狀態感知

- 類似人類的智慧推理能力(如鏈式思考)

- 執行動作的能力

- 處理動態多步驟任務的本領

- 可靠性和適當的授權(確保知道代理代表誰並擁有相應權限)

基於這些標準,BVP 引入了從 L0 到 L6 的自主性等級,以下依序介紹每一級的定義與應用案例。

AI Agent 自主性七個等級 (L0–L6)

L0:無代理能力 (No Agency)

定義: AI 系統完全依賴人工操作,沒有自主性,因此不具備“代理”能力。BVP 認為,純粹由人操控的 AI 工具(例如透過規則引擎或直接人工提示驅動的大型語言模型)不符合 AI 代理的標準。此類系統缺乏自主決策與行動能力,只能在人工指令下產生輸出。

情境例子:

一位開發人員在編輯器中手動輸入提示,讓大型語言模型產生程式碼片段。這種情形下,AI 模型只是根據人的單步指令給出結果,本身並無自主性,因而屬於 L0 級別。

L1:思維鏈推理 (Chain-of-Thought Reasoning)

定義: AI 代理開始展現智慧,能進行鏈式的推理和自我檢查,提高對任務的理解與可靠度。在此層級,代理可透過鏈式思考來解析上下文、多步推理,並在提交答案前自我審視,就像人類在交作業前會自行檢查內容一樣。這種能力讓 AI 的決策過程對人類而言更透明可追蹤,有助於監督其正確性。雖然底層的大型模型日益強大,能隱含地完成部分推理,但在許多應用中明確的鏈式推理過程仍然不可或缺,特別是在強調合規和可靠性的產業中。

情境例子:

一個智慧編程助理具備上下文意識,能理解目前的代碼環境並提供合乎邏輯的建議,同時對自己的建議進行檢討。例如,它會給出帶有推理過程的程式碼建議,並自我批評從而隨時間持續改進建議品質。

L2:AI 副駕駛員 (Conditional Agency as Co-pilot)

定義: AI 代理可以根據環境狀態主動提出行動建議,但仍需要人類在迴路中審核或授權後才能真正執行。換言之,此級別的代理不僅能提供有意義的資訊,還能正確理解資訊並感知環境情境,進而提議下一步行動方案。但最終決策權在人類駕駛手中,代理的計畫需經人工確認或許可才能付諸實行。這種人機協作模式確保了人類對關鍵流程的把關。

情境例子:

在軟體開發中,一個 AI 編程助手可以在整合開發環境(IDE)中自動生成程式碼片段建議,扮演共乘駕駛的角色。不過,程式碼要真正合併部署仍須開發者親自操作,或經由人類主管核准後代理才能直接將更改推送到程式庫。類似地,在客服場景中,AI 可以起草回覆訊息,但必須經人工審閱後才會發送給客戶。

L3:高度自主執行任務 (High Autonomy to Act on Tasks)

定義: AI 代理擁有執行任務所需的權限與信任,可以在強可靠性的前提下自主完成任務。這表示代理已被賦予對操作環境的授權(例如讀寫資料庫、調用系統介面等),能夠不經人為介入自行對系統執行操作,同時保持高準確度和可靠性。由於取得更高的自主權,代理在此階段可獨立地將建議轉化為行動。

情境例子:

一個 AI 程式碼代理可自動產生代碼並直接對代碼庫進行修改,而且修改是正確無誤的,無需人類工程師事後審查。相當於它可以自主地完成既定的開發任務。此外,在商務領域,這類代理也可能自主執行例行業務流程(如自動處理報銷申請)而不需每次人工核對。

L4:完全自主完成工作 (Perform Job)

定義: AI 代理已能獨當一面,如同一名完全自主的AI 員工,可設定目標並完成複雜工作流程。這一層級的代理不僅能理解其所處環境,還能自主規劃任務、應對多步驟且動態變化的工作流程,甚至勝任以前從未遇過的新任務。換言之,AI 代理在此時已具備執行整個職責的能力。

情境例子:

AI 代理可以完全像一位軟體工程師那樣工作。給定一項新功能的開發任務,它能自行完成從需求理解、程式設計、測試到部署的所有步驟,達成預定目標。再比如,在客服領域,一個 L4 等級的 AI 代理可以獨力處理各種客戶問題,從詢問到解決方案提供,全程無需人工介入。

L5:AI 代理團隊 (Teams of Agents)

定義: 多個 AI 代理可以組成團隊協同作業,透過共享訊息和分工合作來實現共同目標。這意味著代理之間能夠互相通信、交換上下文,並平行或序列地執行任務,最終匯聚成果完成複雜專案。團隊中的每個代理或許具備不同的專長,彼此配合就像人類團隊一樣各司其職。

情境例子:

想像一組 AI 代理組成「軟體工程師夢之隊」,有的負責需求分析,有的撰寫代碼,有的測試和部署,彼此同步進度。它們共享專案資料並協調行動,如同一支突擊隊協同作戰,快速地完成了整個軟體開發項目。

L6:管理代理團隊 (Manage Teams of Agents)

定義: AI 代理不僅能與同類協作,甚至能擔任主管角色,管理和優化其他 AI 代理的團隊。處於最高等級的代理具備類似管理者的能力:可以招募或生成新的 AI 工具來加入團隊,評估各代理的表現,指導它們完成任務,提供反饋,必要時還能替換表現不佳的成員。換言之,AI 開始具備自我組織和領導AI 團隊的能力。

情境例子:

一個 L6 級別的 AI 代理可能扮演 AI 專案經理或 AI 團隊主管的角色。例如,面對一項產品功能的上線,它能決定由哪些 AI 代理分別負責市場調研、代碼開發、測試與客服支援等工作,監督各代理的進度並評估成果品質,必要時調整策略,確保整個 AI 團隊高效地實現目標。

等級彙整表格

| 等級 | 名稱 | 定義摘要 | 典型應用範例 |

|---|---|---|---|

| L0 | 無代理能力(No Agency) | 完全被動,僅根據人工指令輸出,無自主決策能力。 | Prompt 驅動的 ChatGPT、Midjourney、規則式聊天機器人 |

| L1 | 思維鏈推理(Chain-of-Thought) | 能多步推理、自我檢查,提升任務理解力與可靠性。 | 解題推理助手、醫療問答 AI、法律分析工具 |

| L2 | AI 副駕駛(Co-pilot) | 可根據情境主動提出建議,但需人類審核才能執行。 | GitHub Copilot、Google Docs 智慧建議、醫療輔診系統 |

| L3 | 高度自主任務執行(Autonomous Task Execution) | 具任務操作權限,能自主完成明確任務,執行環境互動。 | Auto-GPT、AI 執行客服動作、自動化流程機器人 (RPA+AI) |

| L4 | 完全自主完成工作(Perform Job) | 可勝任整體職務,自主規劃與執行複雜工作流程,處理新任務。 | AI 工程師 (Devin)、自主分析師、AI 內容創作者 |

| L5 | AI 代理團隊(Teams of Agents) | 多代理能協同合作、任務分工、共享上下文,完成複雜專案。 | AutoGen 團隊、MetaGPT、模擬 AI 部門運作 |

| L6 | 管理代理團隊(Manage Teams) | AI 擔任主管,能組建、管理、評估其他代理團隊,具備自我組織與調度能力。 | Orchestrator Agent、AI 招募代理、AI 自組織管理系統 |

結論與企業啟示

Bessemer 所提出的 AI Agent 自主性七級架構,勾勒出從輔助工具演進為自主 AI 團隊管理者的清晰路徑。隨著 AI 技術的快速發展,我們正朝向代理式人力(agent-driven workforce)的未來前進。對企業而言,這一框架提供了思考 AI 應用的有力視角:產品設計時可參照等級劃分來決定 AI 的自主程度,從而在提升自動化與維持人為監控之間取得平衡。例如,處於 L2 – L3 級的解決方案也許最適合當前對可靠性要求高的業務,而隨著技術成熟,企業可逐步嘗試邁向 L4 甚至更高級別的應用。同時,管理者可以據此評估自身行業中 AI 部署的成熟度,以制定相應的導入策略。

值得注意的是,隨自主性提高,對AI系統的安全性、可靠性要求也水漲船高,企業需確保在給予 AI 更多自主權的同時,有適當的監管與容錯機制。在未來,我們或將見證 AI 代理擔任各種專業“員工”甚至領導整個 AI 組織的景象這個七級架構為企業提前布局這樣的未來提供了參考依據;無論您正著手開發AI 產品,或是在考慮將 AI 引入業務流程,都可以藉由該框架來評估現況、明確目標,逐步打造屬於自己的 AI 代理實力。藉由審慎地沿著自主性階梯向上攀升,企業將更有能力掌控 AI 轉型的節奏,在激烈的技術變革中保持競爭優勢。